| کد مقاله | کد نشریه | سال انتشار | مقاله انگلیسی | نسخه تمام متن |

|---|---|---|---|---|

| 710470 | 892110 | 2016 | 6 صفحه PDF | دانلود رایگان |

عنوان انگلیسی مقاله ISI

Policy Derivation Methods for Critic-Only Reinforcement Learning in Continuous Action Spaces

ترجمه فارسی عنوان

روش های تشخیص خط مشی برای یادگیری تقویتی انتقادی در فضاهای عملی مستمر

دانلود مقاله + سفارش ترجمه

دانلود مقاله ISI انگلیسی

رایگان برای ایرانیان

کلمات کلیدی

تقویت یادگیری، اقدامات مداوم، سیستم های چند متغیره، کنترل بهینه، مفهوم سیاست

موضوعات مرتبط

مهندسی و علوم پایه

سایر رشته های مهندسی

مکانیک محاسباتی

چکیده انگلیسی

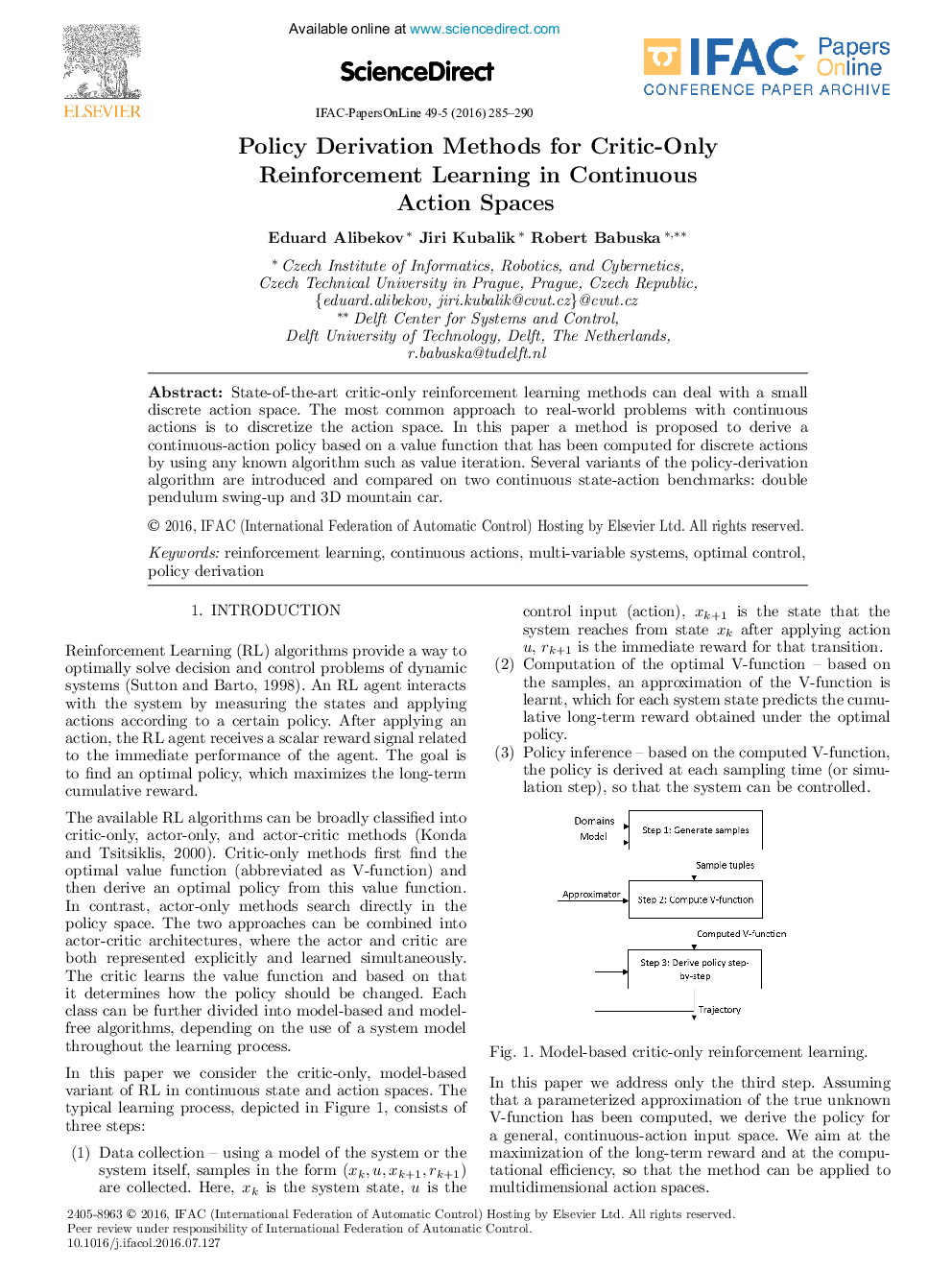

State-of-the-art critic-only reinforcement learning methods can deal with a small discrete action space. The most common approach to real-world problems with continuous actions is to discretize the action space. In this paper a method is proposed to derive a continuous-action policy based on a value function that has been computed for discrete actions by using any known algorithm such as value iteration. Several variants of the policy-derivation algorithm are introduced and compared on two continuous state-action benchmarks: double pendulum swing-up and 3D mountain car.

ناشر

Database: Elsevier - ScienceDirect (ساینس دایرکت)

Journal: IFAC-PapersOnLine - Volume 49, Issue 5, 2016, Pages 285–290

Journal: IFAC-PapersOnLine - Volume 49, Issue 5, 2016, Pages 285–290

نویسندگان

Eduard Alibekov, Jiri Kubalik, Robert Babuska,